Kinh tế

Màu da tối – ác mộng của công nghệ nhận diện khuôn mặt

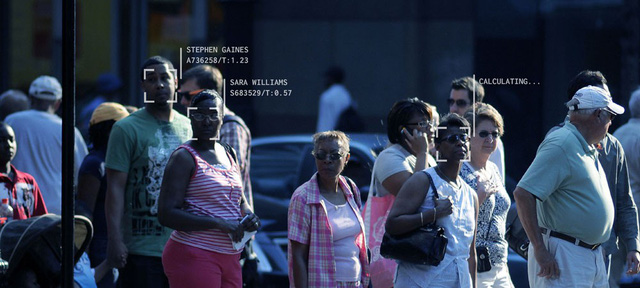

TTO – Các phần mềm nhận diện khuôn mặt hiện nay vẫn đang gặp rắc rối với màu da tối, và hứng chịu nhiều tranh cãi xung quanh.

Sự thật bất ngờ

Theo Bloomberg, vài năm trước, Brian Brackeen đang chuẩn bị trình diễn khả năng của phần mềm nhận diện khuôn mặt với khách hàng, để chứng tỏ đây nó thuận tiện, bảo mật hơn mật khẩu thông thường. Phần mềm bất ngờ không thể hoạt động.

Brian Brackeen, nhà sáng lập công ty Kairos AR. Ảnh: YAEL MALKA FOR BLOOMBERG BUSINESSWEEK.

Anh đã hoảng hốt, cố gắng điều chỉnh lại ánh sáng trong phòng và kết nối Wi-Fi, sau đó cay đắng nhận ra vấn đề nằm ở màu da của mình. Brackeen là người da màu, nhưng tương tự như hầu hết những lập trình viên phần mềm nhận diện khuôn mặt, anh đã dùng hầu hết những khuôn mặt có làn da trắng để ‘tập huấn’ cho thuật toán phần mềm.

Lúc đó, anh nhờ một đồng nghiệp da sáng, tóc vàng trợ giúp và phần mềm đã hoạt động bình thường. Tình huống này khiến anh phải thốt lên: "Cảm giác giống như con ruột bạn mang nặng đẻ đau không nhận ra bạn."

Về sau, Brackeen cho biết đã cải tiến phần mềm bằng cách thêm vào những khuôn mặt da màu, da nâu vào phần cài đặt hình ảnh, nhưng kết quả vẫn chưa khiến anh hài lòng. Hóa ra vấn đề này cũng làm đau đầu nhiều công ty bao gồm cả Microsoft, IBM, và Amazon, ảnh hưởng luôn cả khách hàng của họ.

Công nghệ nhận diện khuôn mặt đang được sử dụng tại Ấn Độ với mục đích tìm kiếm trẻ em mất tích hoặc giúp các tạp chí tại Anh phát hiện ra người nổi tiếng tại tiệc hoàng gia.

Gây tranh cãi hơn là việc nhiều cơ quan hành pháp đang có xu hướng sử dụng công nghệ này trong nhiều trường hợp, mà họ thường không giải thích lí do tại sao và liệu họ đã cân nhắc các sự cố liên quan chưa thì không ai biết cả.

Brackeen tin rằng vấn đề ‘phân biệt màu da’ của công nghệ này đủ nghiêm trọng để cơ quan thực thi pháp luật ngưng sử dụng nó.

Theo một báo cáo công bố bởi các chuyên gia từ Đại học MIT, công nghệ nhận diện khuôn mặt của Microsoft, IBM, và Face++ (từ Trung Quốc) thường xác định sai phụ nữ da màu với tỷ lệ 35%, và với nam giới da màu thì con số này là 12%; bởi hình ảnh khuôn mặt nữ giới ít được đưa vào quá trình ‘huấn luyện’ thuật toán công nghệ. Rõ ràng công nghệ này chỉ hoạt động tốt với những gì nó được dạy.

Công nghệ nhận diện khuôn mặt đang lan rộng tại Trung Quốc. Ảnh: qz.com

Trong thời gian gần đây, các công ty lớn cho biết họ đã và đang làm đa dạng dữ liệu đào tạo AI trong công nghệ này khi thêm vào nhiều dạng khuôn mặt màu da tối và đạt vài bước tiến nhất định.

Microsoft đã công bố một phiên bản phần mềm tạo ra từ công cụ Face API của họ vào 26-6, và giảm tỷ lệ nhận diện sai khuôn mặt phụ nữ da màu xuống tận 1.9% (họ còn khẳng định tỷ lệ này là 0% với các nhóm khuôn mặt khác).

IBM chia sẻ phần mềm nhận diện Watson Visual Recognition của họ chỉ bị lỗi xác định tương tự ở mức 3.5%. Cả hai công ty đều thừa nhận số liệu này vẫn chưa được chứng minh thực tế ngoài thế giới thực, và tỷ lệ sai có thể khác so với kết quả từ phòng nghiên cứu.

Thật ra, chính Amazon mới phải lo lắng nhất. Vào 15-6, một nhóm cổ đông của Amazon đã gửi cho công ty một bức thư, yêu cầu dừng mọi hoạt động marketing hệ thống nhận diện Rekognition mà họ đang hướng đến các bộ cảnh sát và cơ quan chính phủ, cho đến khi công ty hoàn thiện và phát triển thêm các quy tắc để đảm bảo hệ thống không vi phạm nhân quyền.

CEO Jeff Bezos bị yêu cầu ngừng bán Rekognition cho các cơ quan luật pháp. Ảnh: BusinessInsider

Thậm chí những công nhân tại Amazon cũng yêu cầu CEO Jeff Bezos ngừng bán Rekognition cho các cơ quan luật pháp vì "tình trạng đối xử người nhập cư và người tị nạn một cách vô nhân đạo đang gia tăng." Amazon đã từ chối đưa ra bình luận.

Độ chính xác chưa cao nhưng vẫn được sử dụng

Những cơ quan chính phủ chẳng có bất cứ tiêu chuẩn nào đủ tốt để đánh giá hệ thống nhận diện khuôn mặt.

Một nghiên cứu vào năm 2016 bởi Đại học Georgetown phát hiện hầu như những cơ quan này không yêu cầu nhà cung cấp dịch vụ phải đạt đủ một ngưỡng yêu cầu nào về độ chính xác tổng quát, chưa kể yếu tố phân biệt chủng tộc.

Jennifer Lynch, người ủng hộ tự do trực tuyến, bức xúc: "Một hệ thống không chính xác sẽ nghi ngờ người vô tội và đẩy gánh nặng đến những người bị oan do hệ thống không công nhận đúng danh tính của họ."

Bất ngờ hơn, vấn đề với công nghệ này còn hiện diện tại quốc gia khác ngoài Mỹ. Báo cáo từ tổ chức Big Brother Watch tại Anh kết luận công nghệ này quá tệ, sau khi họ tiến hành kiểm tra những khiếu nại được gửi cho nhiều bộ phận hành pháp vốn đang sử dụng nhận diện khuôn mặt.

Sở cảnh sát South Wales được báo cáo rằng công nghệ họ đang áp dụng để xác định danh tính người tham gia tại các sự kiện công cộng, đã nhận diện sai với tỷ lệ 90%. Tuy nhiên, trong thông báo trên trang web của sở này, họ khẳng định công nghệ đã mang lại "thành công vang dội".

Độ chính xác của công nghệ nhận diện khuôn mặt vẫn chưa rõ ràng. Ảnh: perpetuallineup.org

Doanh nghiệp cung cấp công nghệ xác nhận khuôn mặt, gồm cả Microsft và IBM, nói công nghệ vẫn đang tiếp tục trong giai đoạn phát triển, và các kỹ sư đã tập trung vào hoàn thiện độ chính xác và tính minh bạch liên quan.

Họ tin rằng công nghệ đã hỗ trợ bắt giữ tội phạm buôn bán tình dục và bắt giữ những kẻ khủng bố tiềm năng, dù chi tiết họ cung cấp thêm không nhiều.

Andrew Ferguson, giáo sư luật tại Đại học District của Columbia, chia sẻ việc sử dụng một công nghệ mạnh mẽ dù nó vẫn đang trong quá trình phát triển, với độ chính xác không cao, là rất nguy hiểm.

Cơ quan pháp luật đang liên tục đặt niềm tin thái quá vào một thứ từ tiểu thuyết công nghệ. Họ triển khai nó mà không thực hiện quá trình đánh giá nào để loại bỏ nguy cơ sai sót một cách thiên vị hoặc cân nhắc khả năng người dân bị ảnh hưởng.

Lập trình viên thì vẫn đang cải tiến cách họ ‘đào tạo’ thuật toán nhận diện, còn các tổ chức thì vẫn tiếp tục mua công nghệ, nhưng họ có thể sẽ không chịu lắng nghe những yêu cầu siết chặt luật sử dụng.

Nỗi lo về quyền riêng tư

Nhóm nghiên cứu tại Georgetown kêu gọi chính phủ phải quy định lại cách sở cảnh sát sử dụng công nghệ này và thực hiện kiểm tra thuật toán thường xuyên hơn.

Vào tháng 4, một nhóm thuộc các tổ chức bảo vệ nhân quyền lên tiếng cáo buộc việc triển khai công nghệ nhận diện trực tiếp trên camera cảnh sát là "vô quy tắc".

Quyền riêng tư có nguy cơ bị xâm phạm bởi công nghệ này. Ảnh: nec.com

Lynch lập luận nỗi lo sẽ tiếp tục tăng cao khi công nghệ này hoàn thiện hơn. Những ai sử dụng nó có khả năng tạo ra hồ sơ cá nhân người khác với hình ảnh nhận diện chính xác cùng thông tin liên quan như địa điểm, quan hệ gia đình, ghi nhận bầu cử.

Lynch kết luận: "Ngay cả khi độ chính xác từ nó đạt 100%, tôi vẫn không muốn sử dụng. Điều đó có nghĩa mọi hoạt động, danh tính, nơi ở của chúng ta, người cùng trò chuyện… đều bị chính phủ nắm rõ."